Prace nad rozwojem sztucznej inteligencji są niezwykle czasochłonne i wymagają zaawansowanej wiedzy. Dlatego też IBM zaprezentowało rozwiązanie, które umożliwi ochronę własności intelektualnej twórców przed kradzieżą lub bezprawnym wykorzystaniem.

Kilka dni temu IBM poinformowało na swoim blogu, że odnaleziono sposób na to, by chronić ciężką pracę programistów sieci neuronowych przed kradzieżami modeli czy ich niewłaściwymi wykorzystaniami. Wskazano, że jest to problem, z którymi borykają się największe firmy pracujące nad tego typu rozwiązaniami na świecie, w tym IBM.

Zagrożenie kradzieżą i plagiatem

Jak możemy przeczytać w komunikacie, modele deep learning są coraz szerzej stosowane i zyskują na wartości, dlatego też istnieje obawa o ich wykorzystywanie i kradzież własności intelektualnej. Z myślą o tym IBM opracował rozwiązanie, który czerpie z popularnych technik dodawania znaków wodnych do materiałów filmowych i zdjęć.

Watermarking dla AI

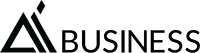

Dodawanie znaków wodnych ma dwa etapy – osadzania, czyli stosowania znaku wodnego i wykrywania, czyli pobierania go, aby sprawdzić własność. Nowy pomysł, który został już zgłoszony do opatentowania, miałby działać stosunkowo podobnie jak oznaczanie zdjęć czy filmów.

Na etapie osadzania właściciel mógłby dodać oznaczenie „copyright” lub też znak wodny niewidoczny dla człowieka i w przypadku, gdyby dany materiał zostałby skradziony i użyty przez innych bez zgody, możliwe byłoby udowodnienie, czyją własnością on jest.

źródło: ibm.com

Umieszczając znaki wodne na modelach DNN, czyli Deep Neuronal Network, w przypadku gdy zostaną one skradzione poprzez wyodrębnienie znaków wodnych z modeli pozwoliłoby na zweryfikowaniem ich własności. Jednakże w odróżnieniu od możliwości oznaczania zdjęć czy filmów, niezbędne jest stworzenie nowego modelu znakowania wodnego dla modeli DNN.

Oznaczanie konkretnymi informacjami

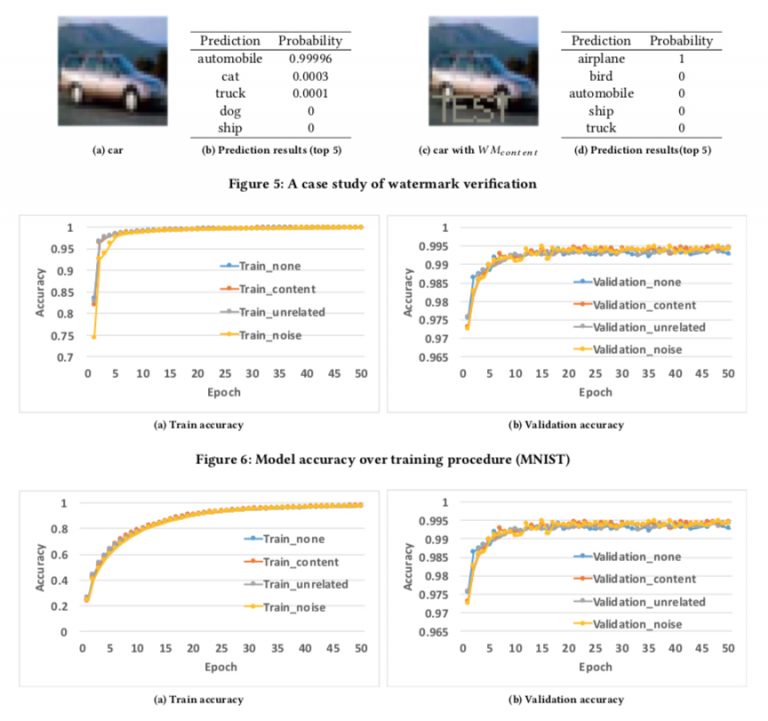

W tym celu zaprezentowano trzy algorytmy, które umożliwią generowanie różnego typu znaków wodnych dla modeli DNN:

- osadzanie znaczących treści wraz z oryginalnymi danymi szkoleniowymi;

- osadzanie nieistotnych próbek danych;

- osadzanie szumów.

Dodanie tych konkretnych informacji w modelach deep learning i wykrycie ich obrazem spowoduje reakcję, która pozwoli na wyodrębnienie znaku wodnego i sprawdzenie czyją własnością owy model jest. IBM deklaruje także, że zadbano, aby tzw. źli aktorzy nie mogli w prosty sposób otworzyć kodu, dostroić, przyciąć lub usunąć znaku wodnego.

Testy tego rozwiązania

Jak możemy przeczytać w komunikacie IBM, przetestowana wspomniane algorytymy za pomocą zestawu danych MNIST, czyli odręcznego zestawu danych do rozpoznawania cyfry zawierającego 60 000 obrazów szkoleniowych i 10 000 obrazów testowych oraz CIFAR10, czyli zbioru danych klasyfikacji obiektów z 50 000 obrazów szkoleniowych i 10 000 obrazów testowych. Wynik pokazał wysoką skuteczność tego rozwiązania.

Projekt wciąż znajduje się na wczesnym etapie lecz IBM planuje wykorzystać tę technikę wewnętrznie, a być może w przyszłości używać jej na szeroką skalę.